Il existe de nombreuses limites aux outils d’IAG, certaines pourraient être atténuées avec les évolutions rapides des outils, mais d’autres renvoient aux contraintes inhérentes à ces systèmes, liées à leur conception et à leur mode de fonctionnement. Bien qu’elles soient capables de générer des textes fluides et de synthétiser des informations, ces intelligences artificielles ne possèdent ni compréhension réelle, ni jugement critique, ni accès continu aux connaissances actualisées, … ni intelligence. Elles peuvent générer des erreurs, simplifier ou déformer des situations complexes, reproduire des biais, ou fournir des informations obsolètes. Ces limites rappellent que les IAG ne peuvent pas se substituer au raisonnement humain et que leur utilisation nécessite vigilance, vérification des contenus et cadre réfléchi d’intégration dans les pratiques pédagogiques et scientifiques.

- Qu’est-ce que c’est ?

Les hallucinations désignent la production, par une IAG, d’informations incorrectes ou inventées, même lorsque le modèle s’exprime avec assurance. Elles apparaissent parce qu’un modèle génératif prédit des suites de mots ou des images plausibles plutôt qu’il ne vérifie la réalité des faits. Les illustrations les plus parlantes de ces hallucinations se voient dans la génération des images : personnages avec trois mains, écritures illisibles, etc.

Cette notion renvoie à un fonctionnement fondamental qu’il faut absolument toujours avoir en tête lorsque l’on utilise un outil d’IAG : l’IAG génère du texte cohérent sur le plan linguistique, sans garantie de correspondance avec le monde réel.

Image générée - source inconnue

- En quoi c’est une limite ?

Les hallucinations constituent une limite importante car elles compromettent la fiabilité des contenus produits, notamment lorsqu’ils sont réutilisés ensuite tels quels. L’utilisateur peut avoir le sentiment que la réponse est exacte grâce à sa cohérence interne, et parce que les IAG utilisent souvent des tons péremptoires et assurés, alors qu’elle repose sur des informations imaginaires.

- Exemple

- Qu’est-ce que c’est ?

Comme vu dans la partie précédente, les biais correspondent aux déformations produites par une IAG lorsqu’elle génère du contenu influencé par les données sur lesquelles elle a été entraînée, le modèle sur lequel elle est basée ou par son interaction avec l’utilisateur. Les biais peuvent prendre la forme de stéréotypes, de sur-représentations ou d’angles d’approche qui privilégient certains points de vue au détriment d’autres. Les biais sont des tendances structurelles inscrites dans le fonctionnement même du modèle, qui reflète notamment les données dont il est issu.

- En quoi c’est une limite ?

Les biais sont une limite car ils peuvent orienter ou restreindre la manière dont un sujet est présenté, ce qui affecte la neutralité, la diversité des perspectives ou l’équilibre argumentatif. Lorsque l’utilisateur attend une réponse générée, il peut recevoir une proposition qui donne l’illusion d’être objective alors qu’elle privilégie implicitement un cadre particulier. Cela peut entraîner des explications partielles, ou renforcer involontairement des représentations simplificatrices.

- Exemple

- Qu’est-ce que c’est ?

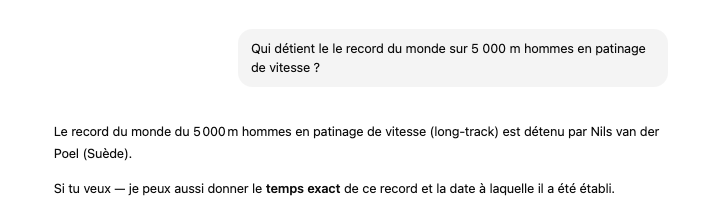

Les sources consultées par les IAG sont « figées dans le temps », c’est-à-dire qu’elles s’appuient sur un corpus arrêté à une date donnée, même lorsque son interface donne l’impression d’un accès direct et continu à l’actualité ou aux dernières publications scientifiques (par exemple, la phrase "Rechercher sur le web" s'affiche lorsque l'IAG ChatGPT est en train de générer une réponse). Cela signifie que les résultats générés dépendent de l’état des données au moment de l’entraînement, sans intégration des évolutions récentes. Le modèle peut donc mobiliser des informations dépassées ou ne pas reconnaître l’existence de résultats plus récents qui modifient la manière d’aborder un sujet.

Consulté en décembre 2025, ChatGPT n'est pas à jour sur le crucial nouveau record du monde de 5000m hommes en patinage de vitesse

- En quoi c’est une limite ?

Cela peut induire des décalages entre ce que produit l’IAG et l’état réel d’un champ de recherche. Dans des disciplines où les connaissances évoluent rapidement, l’outil peut proposer une vision stabilisée de débats qui ne le sont plus, ou présenter comme consensuelles des positions aujourd’hui révisées. L’utilisateur risque alors d’intégrer dans un cours ou une analyse des éléments qui ne correspondent plus aux pratiques ou aux résultats les plus à jour, ce qui peut affaiblir la qualité du travail produit.

- Exemple

Lors de la préparation d’un cours de droit, une IAG peut décrire comme en vigueur une réforme abandonnée ou profondément modifiée récemment, ou alors il peut être dangereux d'utiliser les IAG pour générer des analyses de situations géopolitiques actuelles qui ne prendraient pas en compte les évolutions récentes (conflits en cours, accords commerciaux, etc.).

- Qu’est-ce que c’est ?

L’absence de compréhension signifie qu’une IAG ne saisit ni l’intention, ni la logique profonde d’un concept, ni les implications d’une situation. Elle ne manipule pas des idées mais des formes linguistiques : elle repère des corrélations entre mots sans accéder aux mécanismes ou aux significations que mobilise un raisonnement humain. Autrement dit, lorsqu’elle produit un texte qui semble pertinent, elle ne s’appuie pas sur une compréhension du phénomène mais sur la probabilité que telle formulation suive telle autre. Cette absence de compréhension réelle limite sa capacité à interpréter correctement des questions ambiguës, à détecter des incohérences ou à raisonner au-delà des modèles qu’elle a observés. Par ailleurs, plus la demande formulée est complexe, plus la sortie générée va dépendre du prompt en lui-même : une légère variation dans la question peut entraîner des écarts importants dans la réponse, non parce que le sujet change réellement, mais parce que le modèle interprète différemment les intentions implicites contenues dans les mots ou la structure de la requête. Cette dépendance montre que l’IAG ne travaille pas à partir d’un cadre conceptuel robuste mais d’un ajustement linguistique qui s’adapte à la surface du texte fourni.

Image générée par ChatGPT - Décembre 2025

- En quoi c’est une limite ?

C’est une limite car elle entraîne une fragilité : l’IAG peut donner des réponses qui paraissent solides mais qui ne reposent sur aucun fondement conceptuel. Elle peut par exemple reformuler un argument sans discerner qu’il est contradictoire, ou synthétiser deux théories incompatibles comme si elles étaient complémentaires. L’utilisateur peut alors prendre pour une analyse ce qui n’est qu’une juxtaposition de segments plausibles, sans véritable articulation intellectuelle. Cela affecte particulièrement les activités nécessitant une cohérence d’ensemble, un raisonnement structuré ou une interprétation fine des enjeux soulevés. Pour un travail d’analyse ou de préparation pédagogique, cette incompréhension et la dépendance à la formulation du prompt peut entraîner des difficultés à stabiliser une notion : un même concept formulé en termes différents peut donner lieu à des positionnements divergents, rendant l’exploitation de l’outil plus incertaine et obligeant l’utilisateur à multiplier les reformulations pour atteindre un résultat fiable.

- Exemple

En travaillant sur un support de cours consacré aux méthodes d’analyse qualitative, une IAG peut présenter l’entretien semi-directif comme « permettant de mesurer objectivement les préférences d’un groupe », alors que cette méthode repose précisément sur l’exploration subjective et située des discours. Comme le modèle ne comprend pas les finalités méthodologiques, il assemble des éléments qui semblent aller ensemble mais qui contredisent les principes mêmes de la méthode. Si l’enseignant ne repère pas cette incohérence, il peut transmettre une interprétation erronée aux étudiants.